Introduzione a Google AI Edge Gallery

Quasi un laboratorio IA (personale e riservato) sul proprio cellulare.

In maniera abbastanza sommessa, pochi giorni fa Big G ha rilasciato Google AI Edge Gallery, un progetto open source (bravi!) che segna un passo significativo verso un futuro di Intelligenza Artificiale davvero personale e riservata. Non si tratta di un prodotto commerciale, ma di un'applicazione sperimentale che funge da "laboratorio" interattivo per mostrare le capacità dell'IA generativa quando opera direttamente su un dispositivo, senza dipendere da una connessione a server remoti.

1. Spiegamelo come faresti con un bambino di 5 anni!

Google AI Edge Gallery è un'applicazione dimostrativa per Android (con una versione per iOS in fase di sviluppo) che permette di eseguire grandi modelli linguistici (LLM) e altre soluzioni di Machine Learning interamente in locale. Lo scopo è mettere la potenza dell'IA generativa on-device nelle mani di sviluppatori e appassionati, con vantaggi come:

Privacy: i dati sensibili (come le immagini analizzate o le conversazioni) non lasciano mai il dispositivo.

Accessibilità e Funzionamento Offline: le funzionalità IA sono disponibili anche in assenza di connessione internet.

Bassa Latenza: le risposte sono quasi istantanee, poiché non c'è il ritardo dovuto alla comunicazione con un server cloud.

È importante sottolineare che, data la natura sperimentale, i requisiti hardware non sono trascurabili. Per un funzionamento ottimale, l'app vuole un dispositivo di fascia alta (genere Google Pixel 8, Samsung S23 o successivi) con almeno 6 Gb di RAM e sistema operativo Android 10 o superiore. Ma è comprensibile: l'esecuzione di modelli complessi in locale rimane un'operazione computazionalmente intensiva, anche se il codice è scritto interamente in Kotlin, un linguaggio moderno per lo sviluppo nativo su Android.

2. Dove lo trovo e come lo installo?

Il codice è tutto su GitHub, a questo indirizzo: https://github.com/google-ai-edge/gallery.

L'installazione non avviene tramite il Google Play Store. È necessario un processo chiamato sideloading. Vale a dire che devi:

Scaricare il file dell'applicazione (con estensione .apk) dalla sezione "Releases" del repository GitHub.

Abilitare sul tuo dispositivo Android l'opzione che permette l'installazione di app da "fonti sconosciute".

Installare manualmente il file .apk.

3. Ma a cosa serve?

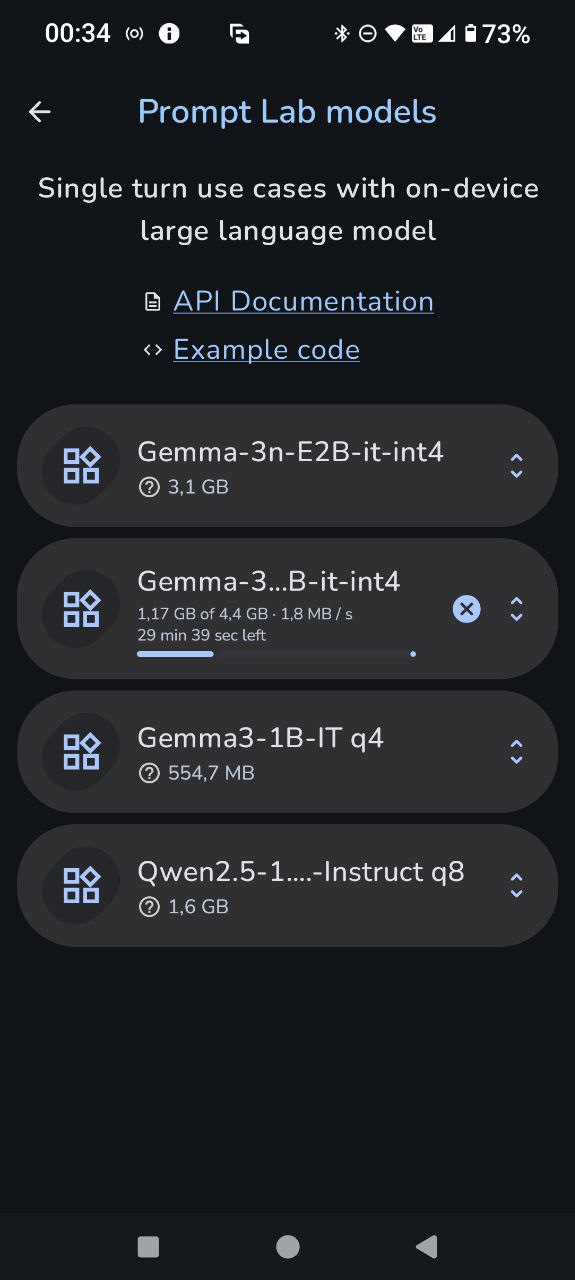

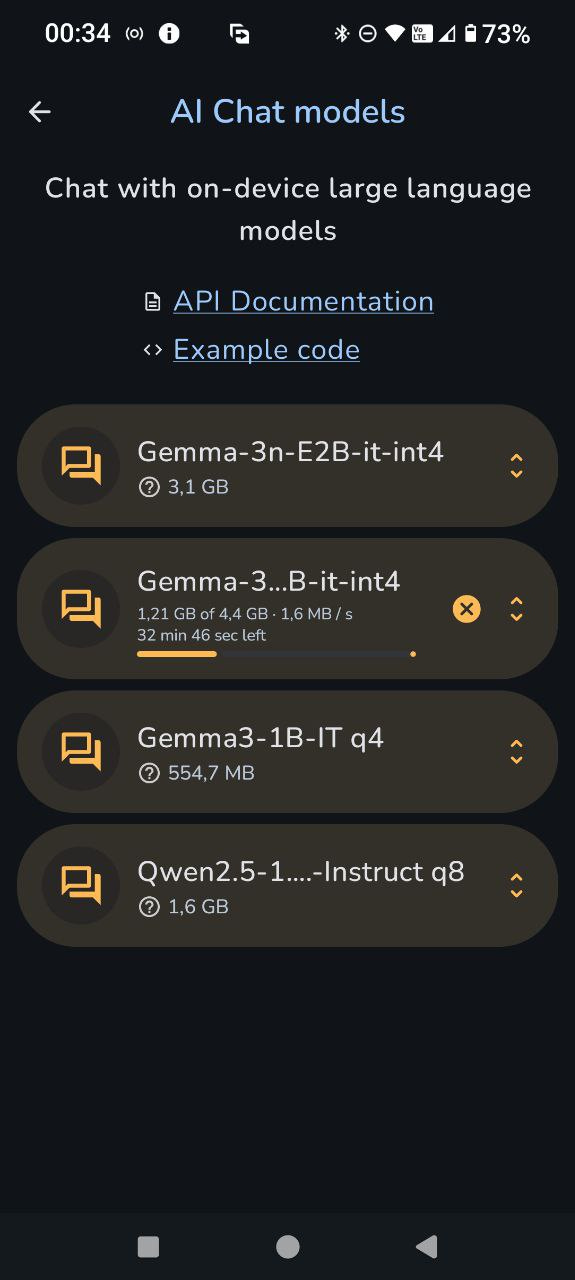

Google AI Edge Gallery si basa su alcune tecnologie chiave di Google come LiteRT (un runtime molto leggero per l'esecuzione di LLM) e la LLM Inference API di MediaPipe (vedi la sitografia finale). Permette di testare diversi modelli, tra cui la famiglia Gemma di Google e altri provenienti dal repository di Hugging Face, come Qwen 2.5. Le funzioni principali sono:

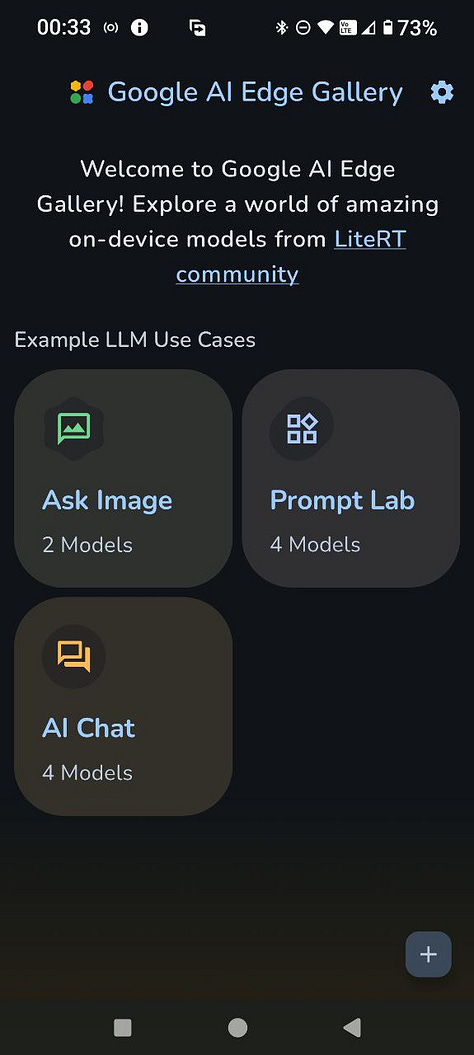

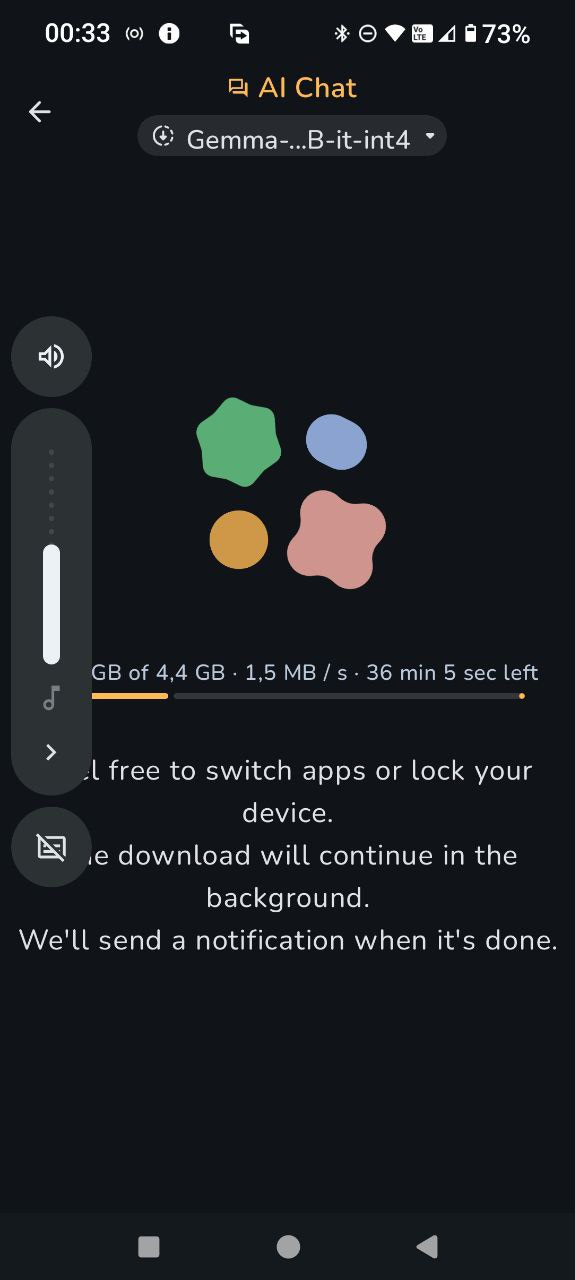

AI Chat: una chat per conversare con un LLM che opera localmente.

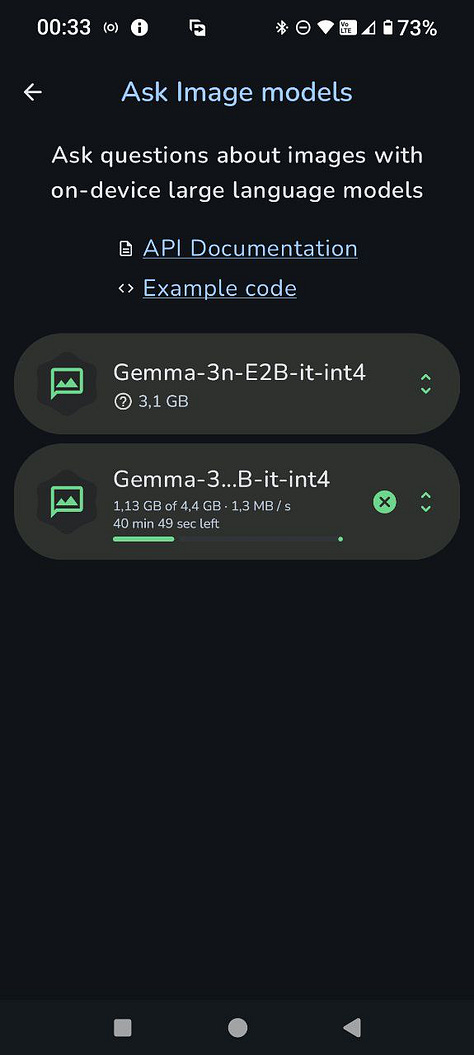

Ask Image: permette di caricare un'immagine dal proprio dispositivo e porre domande dirette sul contenuto. L'ho usato con successo come generatore di prompt, genere "Analizza questa immagine, traine ogni stile, luce, mood, etc. e generami il prompt per ottenerne una simile, ma col soggetto XY".

Prompt Lab: un ambiente per sperimentare con prompt singoli, ottimo per riassunti, riscritture, generazione di codice o altre attività creative basate su testo.

Performance Insights: fornisce dati in tempo reale sulle prestazioni del modello, come la latenza (il tempo per ottenere la prima parola, o Time To First Token), la velocità di decodifica e la Temperature del dispositivo, offrendo un quadro chiaro dello sforzo computazionale.

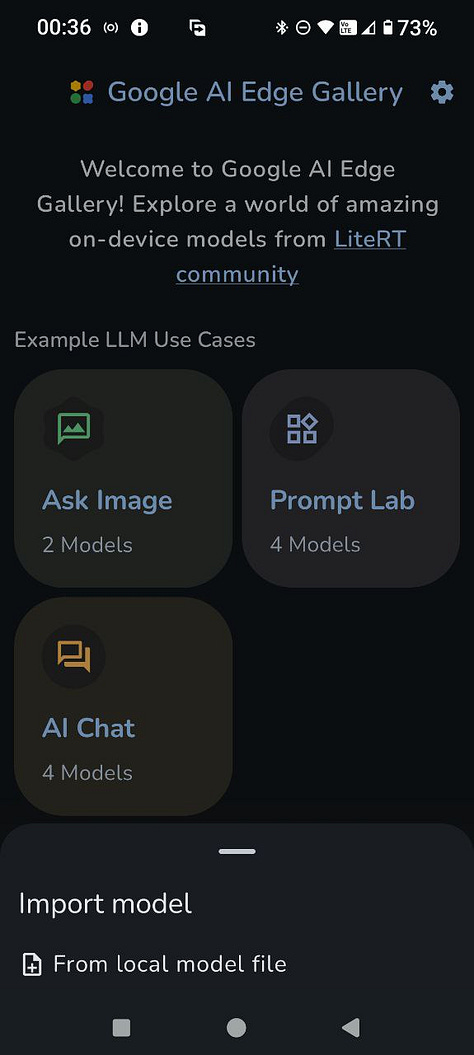

Bring Your Own Model: gli sviluppatori possono caricare e testare i propri modelli personalizzati, a condizione che siano nel formato .task compatibile con LiteRT.

4. Mi serve davvero?

Dipende… Google AI Edge Gallery si rivolge a un pubblico specifico con scopi che vanno dall'apprendimento alla prototipazione. Direi:

Sviluppatori (principalmente Android): è una risorsa didattica e pratica di valore inestimabile. Permette di studiare un'implementazione concreta di IA on-device, capire come utilizzare le più recenti API di Google (come la LLM Inference API di MediaPipe) e testare le performance dei modelli su hardware reale prima di integrarli nelle proprie app.

Studenti e ricercatori di IA: Offre una piattaforma tangibile per condurre esperimenti sull'efficienza e l'efficacia dei modelli on-device, senza la necessità di complesse configurazioni server.

Hacker o inguaribili nerd dal cuore intrepido e lo spirito curioso.

In sintesi: uno strumento per imparare, testare e prototipare, ma ancora non proprio adatto all’uso quotidiano. Permette di esperire (almeno in parte) già oggi quel che succederà domani o al massimo dopodomani, ossia Intelligenze Artificiali non solo come entità remote e centralizzate, ma personali e integrate direttamente nei dispositivi che usiamo ogni giorno.

5. Me la fai vedere?

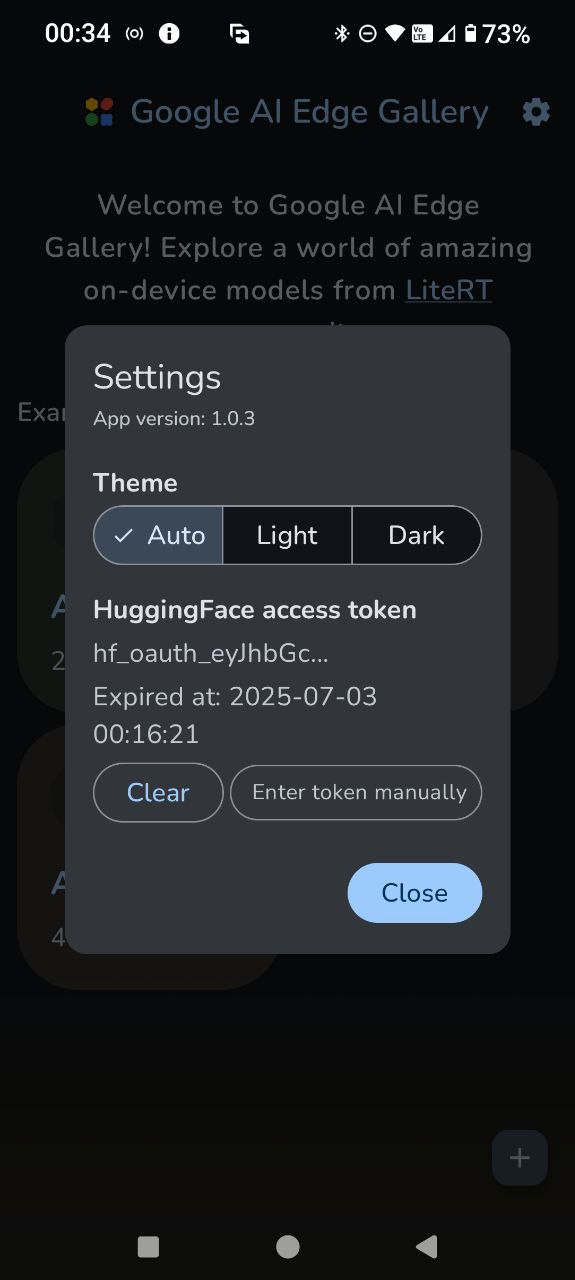

Ecco alcune schermate della mia installazione che dovrebbero risultare abbastanza autoesplicative, almeno per chiunque non sia un absolute beginner.

Sitografia di Riferimento

Google AI Edge Gallery su GitHub: https://github.com/google-ai-edge/gallery

Google AI Edge (panoramica delle tecnologie on-device): https://ai.google.dev/edge

MediaPipe - LLM Inference API (la tecnologia alla base delle funzioni GenAI su Android): https://ai.google.dev/edge/mediapipe/solutions/genai/llm_inference/android